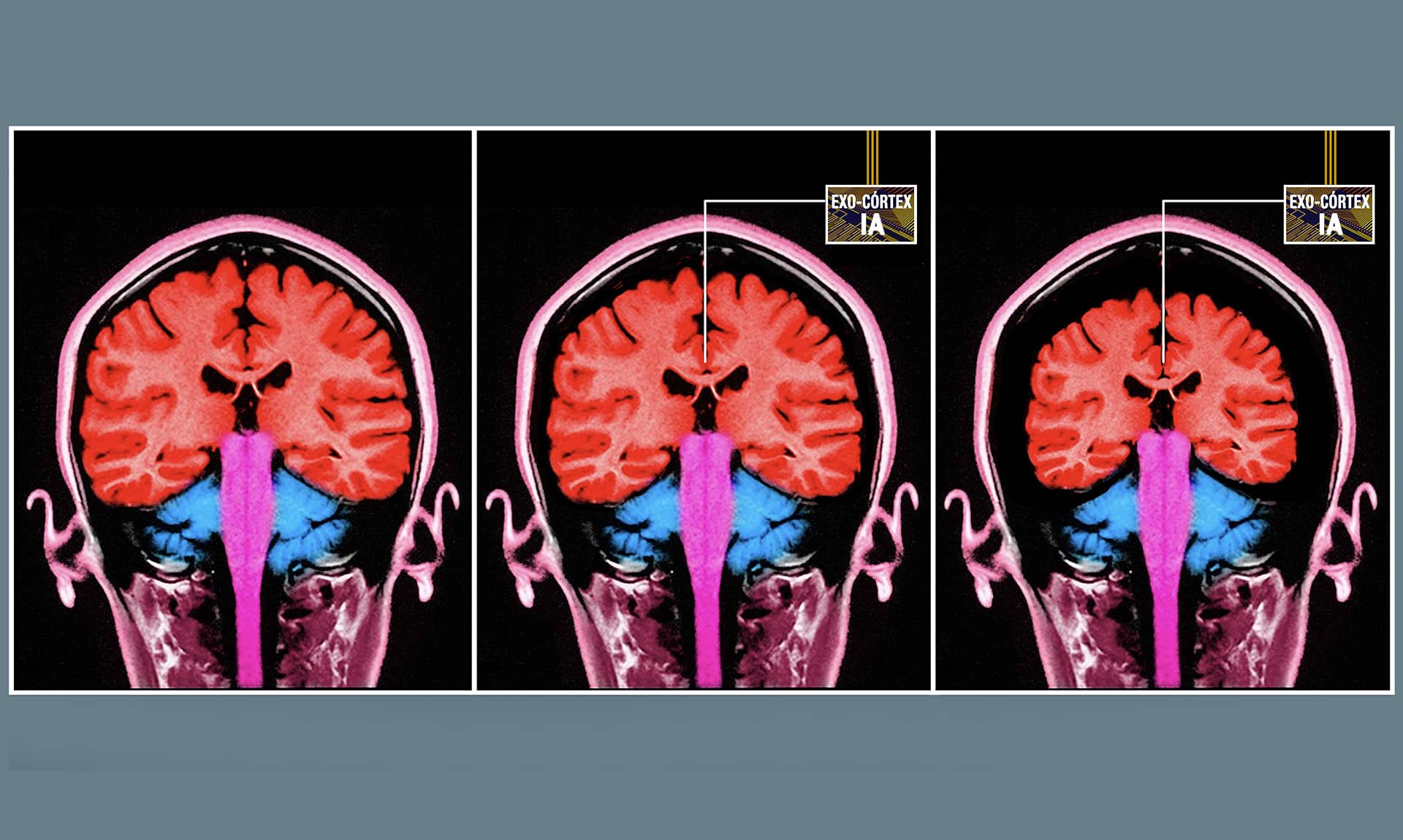

Esquema del posible efecto de conectar el cerebro un exo-cortex artificial que propone Andrej Karpathy para “alquilar” un cerebro extendido, que podría contribuir a desentrenar el cerebro natural reduciendo su uso y capacidades.

Adolfo Plasencia, 21 de noviembre de 2025

Imagen superior: Esquema del posible efecto de conectar el cerebro un exo-cortex artificial que propone Andrej Karpathy para “alquilar” un cerebro extendido, que podría contribuir a desentrenar el cerebro natural reduciendo su uso y capacidades.

El neurocientífico Álvaro Pascual-Leone, en una conversación que tuvimos en que explicaba cómo es el aprender mentalmente para las personas, me enfatizaba «la enorme plasticidad del cerebro, que hace decisivo que haya un entorno humano estimulante rodeando a los niños para su buen aprendizaje». E insistía en que, aunque parezca contradictorio, algo importante en la educación «no es ya que te enseñen datos concretos, porque esos, gracias a Dios se nos olvidan, sino que te enseñen a tener curiosidad para aprender y a saber cómo aprender». …Pascual-Leone, añadía sobre los detalles de cómo funcionan los mecanismos profundos de la inteligencia humana: «Hay que aprender, pero también desaprender en la vida, sin duda… Yo creo que una de las grandes enseñanzas del fantástico trabajo de Eric Kandell, –por el cual le dieron el Nobel de Medicina–, es no ya entender los mecanismos de la memoria en el sentido de cómo se crean memorias nuevas sino también cómo se olvidan memorias y qué mecanismos hay para olvidar… Desde Luria y muchos otros, sabemos que aquellos que tienen la desgracia de no olvidar de forma normal, sufren enormemente por una memoria excesiva, Así que también es importante poder olvidar y desaprender, sin duda…».

Ahora mismo, estamos inmersos en un enorme debate sobre cómo ha de ser nuestra relación con los monstruos cibernéticos de la inteligencia artificial, radicados en gigantescos data centers, en forma de Grandes Modelos Lingüísticos de la IA de los que el ya célebre Chat GPT solo fue una avanzadilla. Para entrenar al Chat GPT se le introdujeron más de 370.000 millones de palabras. Y esto es importante: se hizo, –eso nunca lo cuenta la empresa Open AI–, mediante un latrocinio previo, usando millones de textos y de obras de autores humanos a los que no consultó, ni pidió permiso, ni les dio ningún reconocimiento. (Ni Chat GPT ni los otros modelos de AI muestran jamás títulos de crédito). Fue un entrenamiento con textos, imágenes y obras creadas por humanos, en una cantidad tal, que impresas generarían una inmensa biblioteca cuyo tamaño ni siquiera somos capaces de imaginar. Los conversos y apóstoles de la IA, obvian esto, e imaginan bondades sin cuento que nos traerá la IA a nuestro mundo. Pero sobre él cómo, o a quiénes, en concreto, aún no sabemos.

El Sin ánimo de lucro, como patente de corso desvergonzada para cometer fechorías

En el mundo de la IA se usan muchos disfraces. Podemos comprobarlo ahora que Sam Alman y Open AI, –la startup creadora del Chat GPT–, se han quitado la careta, o disfraz en forma de bandera de corso con la insignia falsa de “sin ánimo de lucro”, ‑bajo ella cometieron el citado latrocinio–, pues han dejado ver abiertamente su verdadero objetivo: ganar mucho dinero, cuanto más mejor y lo antes posible, sin importar las consecuencias aprovechando la ignorancia sorbe lo digital de la gente.

A ese striptease de verdaderas intenciones ha ayudado mucho la mayor apuesta que jamás se había invertido hasta ahora en una startup: 30 mil millones de dólares. Los acaba de invertir en Open AI SoftBank, el conglomerado multinacional japonés con sede, Tokio, que se centra en la gestión de inversiones y que administra Vision Fund, el fondo de capital de riesgo enfocado en tecnología más grande del mundo, con más de 100 mil millones de dólares en capital. A dicha gigantesca inversión ya han dado el visto bueno las autoridades reguladoras estatales de California y las de Delaware, –el mayor paraíso fiscal de dentro de EEUU–. Así, ya tiene a su alcance lo que más chiribitas le hace en los ojos a Altman: sacar Open AI a Bolsa, es decir la multiplicar la capitalización de Open AI de la forma más salvaje y rápida posible. Ahora mismo pues, del espíritu Open (abierto), en la empresa (parte de su disfraz), ya solo queda eso, el nombre. Y recordar ahora el “sin ánimo de lucro” escrito en el acuerdo de fundación de aquella Open AI fundada con 230.000 dólares ya solo mueve a la risa. Formaba parte del disfraz para que el citado latrocinio que hicieron para entrenar al Chat GPT pareciera algo altruista en beneficio de la humanidad que es para lo que decía trabajar el caradura de Altman.

Alguien dijo que la catadura para el engaño de Sam Altam está a la altura de la semántica que utiliza. La startup que fundó para intentar escanear el iris, con escáner esférico Orb a todos los incautos/as que pudiera, –que formaron tras el anuncio, los primeros días generaron largas colas en plena calle‑, la bautizó con el presuntuoso nombre, nada menos, que Tools for humanity (herramientas para la humanidad). Pretendía que a cualquier descerebrado que le dejase escanear su iris (algo más único que su huella dactilar), le recompensaría transfiriendo a su monedero digital (obteniendo con eso sus datos personales), un paquete tokens de una criptomoneda que se inventó, llamada Worldcoin. Según Altman: «esa sería tu recompensa por convertirte en un humano verificado». Afortunadamente la enorme alarma que generó esta iniciativa la convirtió en un fiasco económico.

Ni Chat GPT ni los otros modelos de AI muestran jamás títulos de crédito

Volviendo a la tecnología de la IA, al contemplar las proezas estadísticas de los Grandes Modelos Lingüísticos (Large Language Models LLM, en inglés), que se utilizan para crear ya casi cualquier cosa en una pantalla a partir de prompts (peticiones de texto, o voz), no puedo evitar que sus capacidades intelectuales artificiales me recuerden las de aquel personaje de ficción de Borges de su relato Funes el memorioso, al que el gran escritor, describia así: «…Funes no sólo recordaba cada hoja de cada árbol de cada monte, sino cada una de las veces que la había percibido o imaginado. Resolvió reducir cada una de sus jornadas pretéritas a unos setenta mil recuerdos, que definiría luego por cifras. Lo disuadieron dos consideraciones: la conciencia de que la tarea era interminable y la conciencia de que era inútil». Por cierto, al hilo de ello, ¿qué hacer con todo lo inútil que nos dan las IAs y no les hemos pedido? Ocurre en cada búsqueda con IA. Tal que así, es su modelo de negocio. Es un despilfarro de energía enorme generado por estas formas de la IA Generativa insaciables en energía y recurso hídricos como si fueran algo ilimitado. No lo son.

Neurodependientes de la IA

José Hernández-Orallo me explicó ‚–y creo que tiene razón–, que la inteligencia artificial podría ser la tecnología más transformadora de este siglo. De eso ya no hay duda, pero a los solucionistas de la IA solo les gusta ver las ventajas de forma acrítica tal vez porque consideran que su uso se va a extender de forma irremediable, como un avance tecnológico incuestionable, fruto de un progreso moderno que avanza inexorablemente. Sin embargo, yo creo que esa visión oculta algunas trampas interesadas y es fruto de una posición nihilista que obvia también las consecuencias negativas y sucumbe a sus propias trampas que, previamente, nos han ocultado.

Se está generando tantísima información sobre la IA que podemos leer incluso las promesas más estrambóticas. Entre ellas, una de las más solucionistas es que la IA ha llegado para «extendernos», o «ampliarnos”, o para «mejorarnos»; más que para «sustituirnos», –en este caso referido a nuestros cerebros–. Pura propaganda, porque la realidad de hoy mismo se impone. Por ejemplo, Amazon acaba de anunciar esta semana que planea despedir a 30.000 empleados corporativos solo en EE.UU., casi el 10% de su división corporativa, es decir, que está poniendo en marcha el sustituir a esos humanos por robots de IA, es decir, por software.

Volviendo a palabras de quien cité al principio, Andrej Karpathy, que, por cierto, trabajó desplegando un equipo en Open AI para mejorar Chat GPT 4.0 entre 2017 y 2022, y antes fue director senior de IA en Tesla, donde dirigió el desarrollo de la tecnología de visión artificial del Tesla Autopilot, es, por tanto, alguien muy conocido en la industria de la IA. Después de salir de esas empresas fundó Eureka Labs una empresa que él llama de «IA+Educación», así que lo que voy a decir aquí sobre el aprendizaje, no le es algo ajeno.

Últimamente, Karpathy, poco a poco, ha comenzado a hacer declaraciones más críticas sobre el mundo de la IA, –que antes no había hecho. Hace poco ha declarado: «…en la industria de la IA, tenemos un oligopolio formado por unas pocas plataformas cerradas…, pero creo que cuando empezamos a pensar en lo que dije, –en la IA como un exo-córtex–, puede resultar interesante, aunque también preocupante, porque deduces que una empresa puede acabar controlando tu exo-córtex y, por tanto, una gran parte de ti. Eso empieza a parecer invasivo… Así que te das cuenta de aquello que mencioné; que estás alquilando tu cerebro. Parece extraño lo de alquilar tu cerebro. El experimento mental es, ¿estás dispuesto a renunciar a la propiedad y el control para alquilar un cerebro mejor?». Y, después Karpathy se pone optimista, se viene arriba, y se contesta a sí mismo sin aparente preocupación: «Porque yo sí. Así que creo que ese es el intercambio. Creo. Bueno, veremos cómo funciona».

Veremos, pero no opino como Andrej. Confieso que me da escalofríos solo imaginar lo que Karpathy dice, sobre todo si se da la situación de que eso suceda con miles o millones de cerebros humanos. Y, sobre todo, si el propósito y el modelo de negocio de esas pocas y grandes empresas con ello es ganar dinero, mucho dinero, sin importar las consecuencias para las vidas de la gente corriente. Me da también escalofríos pensar que ese pueda ser el paradigma sobre el que desarrolle su propia empresa que, ya desde el nombre, combina IA y Educación. Sospecho que es una compañía en la que el aprendizaje se entenderá como un desarrollo educativo de personas cuyo aprendizaje vaya de la mano de estos sistemas. Algo que, por ese camino, creo, podrían generar, insisto el que muchas, muchas personas vulnerables acaben emocional y mentalmente dependientes de las App de IA Generativa.

Igual que pasa con la algorítmica de las redes sociales, la de las Apps integradas con IA que persiguen, como primer y casi único objetivo, generar engagement, es decir, adicción en el usuario, buscando, a costa de lo que sea, que se maximice su uso. Estamos empezando a ver que los usos del Chat GPT, que van más rápidamente en aumento son los de usarlo como terapeuta (un 25% de los estadounidenses ya prefiere el Chat GPT antes que un psicólogo); o para consultas sentimentales ante cada duda emocional o dificultad vital por pequeña que sea. De eso a convertirse en neurodepedientes de la IA solo hay un paso.

Entrenar la mente. Desentrenar el cerebro y sus riesgos

Volviendo al entrenamiento ineludible de los Modelos de la IA y a las palabras de Andrej Karpathy, sobre el exo-córtex y lo de alquilar un cerebro mejor, ampliando el tuyo. Haré un enorme flashback ahora, ya que viene al caso. No sé si Karpathy habrá leído el diálogo Fedro de Platón creado en la penúltima fase de su obra, alrededor del año 370 a. C. Es decir, hace unos 2.400 años.

Pues bien, aquí va un flash back, pero doble. Hace ahora 25 años el gran Umberto Eco me envió un precioso texto para participar en un debate que coordiné en el año 2000, que comenzaba citando una crucial escena del Diálogo Fedro del filósofo Platón, que el genial escritor y profesor Eco, con su habitual lucidez, describia así:

«Según Platón (en Fedro), cuando Hermes, el presunto inventor de la escritura, presentó su invento al faraón Thamus, éste alabó su nueva técnica que se suponía iba a permitir a los seres humanos recordar lo que de otro modo olvidarían. Pero, al parecer, el faraón no estaba tan satisfecho. «Mi hábil Theut, –le dijo–, la memoria es un gran don que se debe mantener viva entrenándola constantemente. Con tu invento, la gente ya no se verá obligada a entrenar la memoria. Recordarán cosas no debido a un esfuerzo interno, sino meramente en virtud de un dispositivo externo».

Podemos entender la preocupación del faraón, –dice Eco–. La escritura, como cualquier otro nuevo dispositivo tecnológico, hubiera aletargado la capacidad humana que es sustituida y reforzada –al igual que los coches reducen nuestra capacidad de andar–. La escritura era peligrosa para el Faraón, porque reducía las capacidades de la mente, ofreciendo a los seres humanos un alma petrificada, una caricatura de la mente, una memoria mineral».

Imagino cómo de desilusionado se quedaría Hermes, pero de esa memoria mineral, en traducción de Eco, se puede extrapolar fácilmente lo del exo-córtex «aumentado con IA» al que se refería Karpathy. Lo que no sé, es si él, –forofo de la IA–, lo imagina como un alma petrificada o una caricatura de la mente, tal como la denomina Umberto Eco. Para mí, la descripción de «memoria mineral (de silicio)» sí parece coincidir con el mismo concepto que, al parecer según cuenta Platón, preocupaba al faraón Thamus.

Volviendo al presente, ya es fácil deducir que, con la IA, debido a la actual y tan de moda comodidad nihilista, muchos pronto pensarán que, disponiendo de ese «exo-córtex aumentado artificialmente», tal vez ya no considerarán a la memoria humana como un gran don que se debe mantener viva entrenandola constantemente. Es más, con la actual mentalidad solucionista que promueven los evangelistas de la IA, mantener el cerebro entrenado constantemente les parecerá, probablemente, algo obsoleto y anticuado. El citado Pascual-Leone me aseguró también aquella vez que el cerebro es, además de plástico, «como un músculo cuyo buen funcionamiento exige uso y aprendizaje constante, con riesgo de atrofiarse gradualmente si no se le entrena cognitivamente, de forma adecuada».

El cerebro es como un músculo con riesgo de atrofiarse gradualmente si no se le entrena cognitivamente

En su libro “El cerebro que cura» explica su propósito y la manera de lograr, combinando una mente, un cuerpo y un alma sanos, el mantener y mejorar la salud y la vida de cualquier persona. Pero, quizá el propósito de la industria de la IA a la que pertenece Karpathy, en relación al bienestar para las personas, no sea el mismo en el que piensa Pascual-Leone.

Puede que el impacto de esta invasión de la IA sea, en el contexto del mundo de la educación y el aprendizaje, algo impuesto sin debate previo por la industria de las big tech y la IA. Y, con ello, se vuelva a repetir lo que ya sucedió con la colonización masiva de las aulas por las pantallas digitales, las redes sociales y la conexión ubicua; y algo sobre lo que el psicólogo clínico infanto-juvenil Francisco Villar declaraba recientemente: «El debate debería haber sido previo. ¿Dónde estaban los estudios que demostraban que se iba a mejorar en algún aspecto la situación?». Y añade, en una entrevista de Pablo García Santos, al que declara: «¿Y el balance de riesgos? ¿Por qué estábamos incorporando ese uso de pantallas en niños sanos? Tendríamos que haber sabido antes si ello tenía consecuencias o no». En ese sentido, puede seguir ocurriendo lo que señala Catherine L’Ecuyer, doctora en Educación y Psicología y autora de Educar en la realidad: «Hemos hecho un ensayo con una generación entera introduciendo un producto sin probar que daba buenos resultados»; y aclara «…digitalizamos de forma masiva las aulas porque era sinónimo de progreso y modernidad, pero no teníamos pruebas del impacto positivo para el aprendizaje». Ahora estamos asistiendo a las consecuencias.

En síntesis, esta nueva vuelta de tuerca tecnológica de «aumentarnos con IA» puede ser en muchos casos y para muchas personas, masivamente, tal vez una forma en realidad de lo contrario, es decir, de «disminuirnos», reduciendo nuestras capacidades mentales naturales alejándonos de ese entrenamiento cognitivo constante en la educación del que hablaba en su libro Pascual-Leone, pero también por abandonar el esfuerzo constante del cerebro en la vida cotidiana como buen entrenamiento. Sinceramente, creer que vas a mejorar tus capacidades, simplemente «alquilando un cerebro mejor» con un exo-córtex de IA a las big tech, como dice Andrej Karpathy, me parece una boutade. Es más, creo que es una pésima idea y una aberración.

Pero frente a ello, como suele suceder, tampoco hay que negarlo, hay quién lo ve de otra manera. La exótica idea del exo-córtex de Karpathy, sigue ganando adeptos. Stephanie Kossman y Danielle Roedel, Laboratorio Nacional de Brookhaven, este enero de 2025, la usaron como argumento científico para lograr una suerte de nueva imaginación artificial, nada menos, que «conceptualizando el exo-córtex como una extensión del cerebro de un científico».

El uso del chat GPT y chatbots similares, podría ser un equivalente de la idea del exo-córtex artificial que propone Andrej Karpathy. Y, probablemente, el efecto de su uso intenso a largo plazo podría acabar en una jibarización del cerebro y sus funciones principales.

¿Usar las aplicaciones con IA nos va a hacer más listos, o más estúpidos?

Como último punto quiero recordar un famoso artículo publicado por Nicholas Carr, el verano de 2008 en la revista The Atlantic, titulado «¿Está Google haciéndonos estúpidos?». Como Carr seguía preocupado después por la evolución de los efectos nocivos del mal uso de la tecnología y la red, en 2010, publicó un libro cuyo título ya no es una pregunta, si no una afirmación: Superficiales: Lo que Internet está haciendo con nuestras mentes, que ha sido traducido a 17 idiomas. Sin embargo, a pesar de avisos tan potentes como los de Carr, la apropiación masiva de uso de los chatbot de IA por la gente no ha hecho sino crecer. Estoy convencido de que hacernos dependientes de las IA, con el uso constante del Chat GPT y, ahora, de otras como Sora2 o la viral Nanobanana –nombre informal de Gemini 2.5 Flash Image, una potente herramienta de edición y generación de imágenes con IA de Google–, y muchas Apps de IA que aparecen cada día, puede generar el desentrenamiento de habilidades intelectuales y destrezas creativas a escala masiva, gracias a la adicción y la comodidad nihilista y los nefastos usos que promueven las big tech de la IA. Y, además, provocar un efecto de deterioro de la educación y el aprendizaje. Son trampas cognitivas digitales en toda regla y, por su eficacia en ello, casi infalibles.

Con la expansión de la IA Generativa surgieron nuevas promesas de que podría revolucionar la educación y marcar el comienzo de una era de aprendizaje personalizado para los estudiantes, a la vez que reducía la carga de trabajo de los docentes. Pero se da el caso de que casi toda la investigación que ha encontrado beneficios en la introducción de estas tecnologías en las aulas está financiada por la industria de la tecnología educativa y, la mayoría de las investigaciones independientes a gran escala han demostrado empíricamente que un mayor tiempo frente a la pantalla obstaculiza el logro académico. Un estudio global de la OCDE descubrió, por ejemplo, que cuanto más usan los estudiantes ciertas tecnologías en las escuelas e institutos, –de la forma que la promueven las big tech–, peores son sus resultados.

Tanto Fran Villar, como la doctora L’Ecuyer, coinciden en ello y en que se introdujeron en la enseñanza y la vida de los niños y adolescentes sin suficientes pruebas sobre sus beneficios. Wayne Holmes, profesor de estudios críticos de inteligencia artificial y educación en el University College de Londres, también coincide con esa opinión cuando dice: «Simplemente no hay evidencia independiente a gran escala que respalde la efectividad de estas herramientas. …En esencia, lo que ocurre con estas tecnologías es que estamos experimentando con niños».

Ya pasó con las tecnologías de la conexión ubicua de los smartphones y la algorítmica de las redes sociales. Y, es en este contexto en el que ha surgido también la IA Generativa, con una propuesta que parece completamente novedosa. Hasta hace poco, solo se podía externalizar la memorización y parte del procesamiento de datos a la tecnología; ahora se puede externalizar el pensamiento mismo. Dado que pasamos la mayor parte de nuestras vidas sintiéndonos sobreestimulados y agotados, no es de extrañar que tantos hayan aprovechado la oportunidad de dejar que el ordenador, y ahora el teléfono móvil, nos posibiliten que sus Apps hagan muchas cosas que mentalmente antes hacíamos por nosotros mismos, como, por ejemplo, redactar informes de trabajo o correos electrónicos, o planificar unas vacaciones. A medida que pasamos de la era de internet a la era de la IA, lo que consumimos no solo es cada vez más información ultraprocesada y de bajo valor, sino más información esencialmente pre-digerida y entregada de una manera diseñada para eludir funciones humanas importantes, como evaluar, filtrar y resumir información, o enfocar realmente un problema, en su lugar adoptar la primera solución fácil que se nos presenta en la pantalla.

En la era de la IA, consumimos es cada vez más información ultraprocesada de bajo valor, esencialmente pre-digerida, para eludir funciones humanas importantes, como evaluar, filtrar y resumir información, o enfocar realmente un problema

Todo esto, en realidad, desaparece cuando las pantallas se apagan y/o cortando la conexión online ubicua con las redes sociales y las IA Generativas. La gran incógnita es cómo se podrían conseguir extender los buenos usos y el aprovechamiento de las IAs y combinar las oportunidades que traen, sin dejar de entrenar nuestro cerebro con cosas tan simples como leer largos textos impresos o escribir a mano cotidianamente.

Hay otro ejemplo que es extrapolable al respecto. Un estudio con EEG (electroencefalogramas) de alta densidad, de junio de 2023, del Laboratorio de Neurociencia del Desarrollo de la Universidad Noruega de Ciencia y Tecnología de Trondheim, publicado en Frontiers in Psychology demuestra que «escribir a mano, –pero no en el teclado–, provoca una conectividad generalizada en el cerebro. Según los científicos, ello puede tener grandes implicaciones para el aula y la educación». Los científicos entran en el detalle profundo y dan pruebas contundentes halladas en su investigación: «…al escribir a mano, los patrones de conectividad cerebral son mucho más elaborados y complejos que al escribir con un teclado, como mostraron los patrones generalizados de coherencia de conectividad theta/alfa entre los nodos de la red cerebral y los nodos de las regiones parietales y centrales del cerebro».

Y concluyen «La literatura científica existente indica que los patrones de conectividad en estas áreas cerebrales, a tales frecuencias, son cruciales para la formación de la memoria y para codificar nueva información y, por lo tanto, son muy beneficiosos para el aprendizaje… Nuestros hallazgos sugieren que el patrón espaciotemporal de la información visual y propioceptiva obtenida a través de los movimientos de la mano controlados con precisión al utilizar un bolígrafo o un lápiz, contribuyen ampliamente a aumentar los patrones de conectividad del cerebro que empujan el aprendizaje. Así que, instamos a que los niños, desde una edad temprana, estén expuestos a actividades de escritura a mano en la escuela y el instituto para establecer los patrones de conectividad neuronal que proporcionan al cerebro unas condiciones óptimas para el aprendizaje». En consecuencia, escribir a mano en absoluto debería ser considerado algo obsoleto en los entornos educativos. Al contrario. Los científicos concluyen en el estudio que «tanto profesores como alumnos, deben ser conscientes de que esta práctica tiene el mejor y más potente efecto en el aprendizaje, como ocurre, por ejemplo, con el tomar apuntes de clase, o escribir una redacción a mano».

No solo este estudio lo muestra. Cada vez más investigaciones demuestran que el escribir a mano activa partes del cerebro que desempeñan un papel crucial en el aprendizaje, y ayuda a los niños a reconocer palabras y letras. Tomar notas a mano también promueve el desarrollo de la memoria, al obligarnos a sintetizar y priorizar la información. En cambio, al escribir siempre con teclado, genera que la información «puede entrar por un oído y salir por el otro».

Tengo otro ejemplo más, convergente y significativo. A principios de abril de este año, alguien poco sospechoso de ir contra las tecnologías como el CEO de Amazon, Andy Jassy, causó un tremendo revuelo con un memorando interno enviado a los empleados de su empresa, advirtiendo que la inteligencia artificial (IA) podría desplazarlos, –luego fue muy criticado por los trabajadores, por esa afirmación–. Pero es interesante porque en él hace afirmaciones sorprendentes en alguien de su posición como: «el verdadero peligro es que la dependencia excesiva de la IA pueda generar una generación de jóvenes descerebrados, incapaces de afrontar los trabajos del futuro porque nunca han aprendido a pensar de forma creativa ni crítica». El citado Jassy se atrevió a señalar que hipotéticamente «…a medida que la IA se vuelve más inteligente, los jóvenes universitarios podrían volverse más ingenuos (y más torpes)». Esto es mucho decir, sobre todo, en boca del CEO de Amazon. El memorando fue actualizado de inmediato en la carta anual a los accionistas del 10 de abril, que es pública, en un tono bastante distinto, deshaciéndose en ella en elogios para la IA en el futuro de la empresa. Pero lo dicho, dicho queda.

¿Está la IA Generativa haciéndonos más estúpidos?

Allysia Finley, que analizó semanas después el tema en el Wall Street Journal, afirma en su texto que «el cerebro continúa desarrollándose y madurando hasta los veintitantos, pero, al igual que un músculo, necesita ejercitarse, estimularse y desafiarse para fortalecerse. Las tecnologías de la IA, pueden frenar este desarrollo al realizar el trabajo mental que construye la versión cerebral en una nube informática. Es un fenómeno denominado descarga cognitiva». Los estudiantes universitarios y de secundaria utilizan masivamente, cada vez más, los grandes modelos lingüísticos como los citados ChatGPT, Gemini, –y ahora Sora2 o Nanobanana de Google, que se han vuelto virales–, para escribir trabajos, realizar pruebas matemáticas y crear código informático. La realidad es que, sobre todo los y las adolescentes, han empezado masivamente a descargar estos retos cognitivos en la IA.

Y, al respecto, Finley afirma rotunda: «el verdadero peligro es que la dependencia excesiva de la IA pueda generar una generación de jóvenes descerebrados»; Eso, tras ir mucho más allá ya en el título de su artículo en el Wall Street Journal: «La mayor amenaza de la IA: los jóvenes que no pueden pensar”. Luego señala: «los ordenadores inteligentes requieren humanos aún más inteligentes, pero sus promotores nos tientan peligrosamente a practicar una «descarga cognitiva». Y culmina, «…añadamos la pereza intelectual a la larga lista de problemas que asolan la enseñanza superior. Muchos estudiantes ni siquiera revisan sus trabajos generados por IA antes de presentarlos». El desastre siguiente ante su profesor, lo podemos imaginar.

Si le preguntas, como he hecho yo, a una App de IA, por ejemplo, a Gemini de Google, sobre cuál es su propósito te dice literalmente que: «la IA no tienen voluntad ni intenciones personales, sino que está diseñada para cumplir funciones específicas y agradar a través de la utilidad y la efectividad de su propósito». Después, la IA ya entra en bucle, repitiendo una y otra vez lo mismo, con agradables palabras diferentes. Pues eso. Pero intenta agradar por los límites de seguridad muy estrictos que le han puesto ya que, si no los tuviera, como cualquier gran Modelo LLM de AI se podría convertir en un monstruo. Aún así provocan desgracias una y otra vez con personas vulnerables, pero parece que a las empresas líderes de la industria de la IA no les importa. The Guardian, y también la BBC, publicaron ayer 27 de octubre que, «según estimaciones de OpenAI, más de un millón de personas muestran cada semana intenciones suicidas al chatear con ChatGPT». Eso no significa que la empresa vaya a cambiar su conducta por esto. Como ya ha demostrado, no cambiará, sabiendo esto, su modelo de negocio en absoluto.

En conclusión, y además, volviendo a Carr, por si se le ocurre publicar otra entrega en su línea de las anteriores, espero que no sea con una pregunta como ¿Está la IA Generativa haciéndonos más estúpidos?, porque creo que se quedará corto con la pregunta, sobre todo, con respecto a los más vulnerables de nosotros. Va a ser mucho más que eso. Y eso significa que afectará a mucha gente y, muy probablemente, va a tener un impacto enorme. Con todo lo dicho, si tenemos, como debe ser, una visión crítica, es fácil de imaginar qué podría salir mal.

Comparte esta publicación

Suscríbete a nuestro boletín

Recibe toda la actualidad en cultura y ocio, de la ciudad de Valencia